Актуальные темы

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

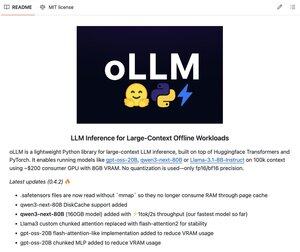

oLLM — это легковесная библиотека Python для локального вывода LLM с большим контекстом.

Запускайте gpt-oss-20B, Qwen3-next-80B, Llama-3.1-8B на потребительском GPU за ~$200 с всего лишь 8 ГБ VRAM. И это без какой-либо квантизации — только точность fp16/bf16.

100% с открытым исходным кодом.

Топ

Рейтинг

Избранное