Populære emner

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

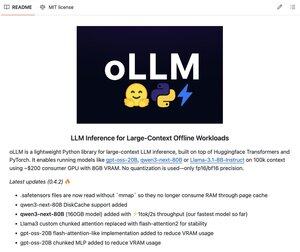

oLLM er et lett Python-bibliotek for lokal LLM-slutning i stor kontekst.

Kjør gpt-oss-20B, Qwen3-next-80B, Llama-3.1-8B på ~$200 forbruker-GPU med bare 8 GB VRAM. Og dette er uten kvantisering - bare fp16/bf16 presisjon.

100 % åpen kildekode.

Topp

Rangering

Favoritter