Trend-Themen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

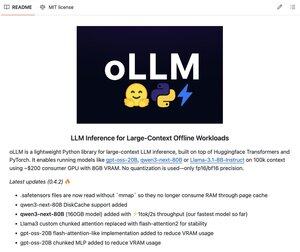

oLLM ist eine leichte Python-Bibliothek für die lokale Inferenz von LLMs mit großem Kontext.

Führen Sie gpt-oss-20B, Qwen3-next-80B, Llama-3.1-8B auf einer ~$200 Verbraucher-GPU mit nur 8 GB VRAM aus. Und das ist ohne jegliche Quantisierung - nur mit fp16/bf16-Präzision.

100% Open Source.

Top

Ranking

Favoriten