Rubriques tendance

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

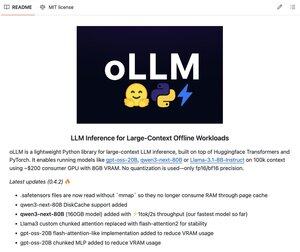

oLLM est une bibliothèque Python légère pour l'inférence LLM à grand contexte en local.

Exécutez gpt-oss-20B, Qwen3-next-80B, Llama-3.1-8B sur un GPU grand public d'environ 200 $ avec seulement 8 Go de VRAM. Et cela sans aucune quantification - uniquement en précision fp16/bf16.

100 % Open source.

Meilleurs

Classement

Favoris