Tendencias del momento

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

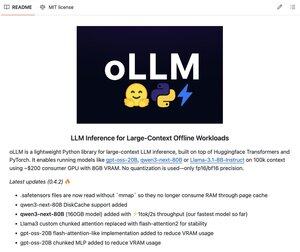

oLLM es una biblioteca ligera de Python para la inferencia local de LLM de gran contexto.

Ejecuta gpt-oss-20B, Qwen3-next-80B, Llama-3.1-8B en una GPU de consumo de ~$200 con solo 8GB de VRAM. Y esto es sin ninguna cuantización, solo con precisión fp16/bf16.

100% de código abierto.

Parte superior

Clasificación

Favoritos