Popularne tematy

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

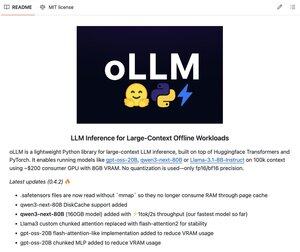

oLLM to lekka biblioteka Pythona do lokalnego wnioskowania LLM o dużym kontekście.

Uruchom gpt-oss-20B, Qwen3-next-80B, Llama-3.1-8B na GPU konsumenckim za około 200 USD z zaledwie 8 GB VRAM. I to bez jakiejkolwiek kwantyzacji - tylko precyzja fp16/bf16.

100% otwarte źródło.

Najlepsze

Ranking

Ulubione