المواضيع الرائجة

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

جون شولمان &آلات التفكير: LoRA دون ندم

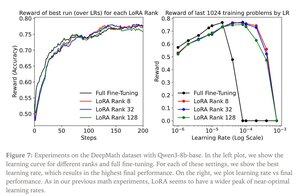

يستبدل LoRA كل مصفوفة وزن W من النموذج الأصلي بنسخة معدلة W'=W+γBAW'=W+γBA, حيث B و A هي مصفوفات تحتوي معا على معلمات أقل بكثير من W.

يعمل LoRA بشكل مشابه للضبط الدقيق الكامل عندما:

1. يتم تطبيق LoRA على جميع طبقات الشبكة, خاصة طبقات MLP / MoE التي تضم معظم المعلمات.

2. LoRA ليست مقيدة بالسعة ، أي أن عدد المعلمات القابلة للتدريب يتجاوز كمية المعلومات المراد تعلمها ، والتي يمكن تقديرها من حيث حجم مجموعة البيانات.

الآثار: يمكن تخصيص النماذج الأساسية الكبيرة (مثل تريليون معلمة) بجزء بسيط من تكلفة تدريب نموذج جديد.

وظيفة آلات التفكير:

الجوزاء على متطلبات الحوسبة ل LoRA على نموذج حدودي - لا يزال هائلا ، لكن عدد المعلمات المستخدمة أقل من 1٪ من إجمالي حجم النموذج (التدريب المسبق).

3.4K

الأفضل

المُتصدِّرة

التطبيقات المفضلة