Populære emner

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

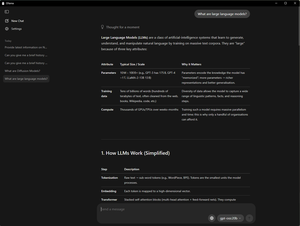

Kom i gang med å kjøre LLM-er lokalt med @Ollama – opplev ytelsesforbedringer på RTX AI-PC-er som kjører Gemma 3 og gpt-oss.

Dra. Dråpe. Prate. Gjenta. Få mer informasjon 👉

Topp

Rangering

Favoritter