Tendencias del momento

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

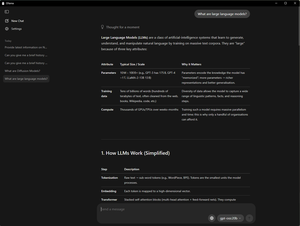

Comienza a ejecutar LLMs localmente con @Ollama: experimenta mejoras de rendimiento en PCs RTX AI que ejecutan Gemma 3 y gpt-oss.

Arrastra. Suelta. Chatea. Repite. Aprende más 👉

Parte superior

Clasificación

Favoritos