熱門話題

#

Bonk 生態迷因幣展現強韌勢頭

#

有消息稱 Pump.fun 計劃 40 億估值發幣,引發市場猜測

#

Solana 新代幣發射平臺 Boop.Fun 風頭正勁

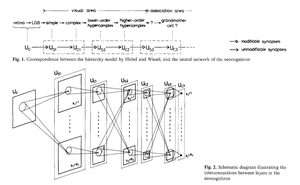

誰發明了卷積神經網絡(CNN)?

1969年:福島提出了與CNN相關的ReLU。

1979年:福島擁有基本的CNN架構,包括卷積層和下採樣層。當時的計算成本是1989年的100倍,今天的10億倍。

1987年:瓦伊貝爾將林奈馬的1970年反向傳播應用於具有一維卷積的權重共享TDNN。

1988年:張偉等人將“現代”反向傳播訓練的二維CNN應用於字符識別。

以上所有內容均於1979年至1988年在日本發表。

1989年:LeCun等人再次將CNN應用於字符識別(郵政編碼)。

1990-93年:福島基於空間平均的下採樣被最大池化取代,應用於一維TDNN(山口等人)和二維CNN(翁等人)。

2011年:更晚些時候,我的團隊與丹·西雷森一起使最大池化CNN在NVIDIA GPU上變得非常快速。2011年,DanNet實現了首個超人類模式識別結果。曾經一度,它享有壟斷地位:從2011年5月到2012年9月,DanNet贏得了它參加的每一個圖像識別挑戰,連續贏得4次。誠然,這主要是關於工程和擴展前千年的基本見解,並從更快的硬件中獲利。

一些“AI專家”聲稱“使CNN運作”(例如,參見[5,6,9])與發明它們一樣重要。但“使它們運作”在很大程度上取決於你的實驗室是否有足夠的資金購買最新的計算機,以擴展原始工作。這與今天是相同的。基礎研究與工程/開發 - 研發中的R與D。

參考文獻

[1] K. Fukushima (1979)。一種不受位置變化影響的模式識別機制的神經網絡模型 - Neocognitron。IECE轉載,第J62-A卷,第10期,第658-665頁,1979年。

[2] K. Fukushima (1969)。通過多層網絡的視覺特徵提取 - 類比閾值元件。IEEE系統科學與控制論學報。5 (4):322-333。這項工作引入了修正線性單元(ReLU),現在在許多CNN中使用。

[3] S. Linnainmaa (1970)。碩士論文,赫爾辛基大學,1970年。第一篇關於“現代”反向傳播的出版物,也稱為自動微分的反向模式。(參見施密德胡伯的著名反向傳播概述:“誰發明了反向傳播?”)

[4] A. Waibel。使用時間延遲神經網絡的音素識別。IEICE會議,東京,日本,1987年。對具有一維卷積的權重共享TDNN的反向傳播。

...

熱門

排行

收藏