Tópicos em alta

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

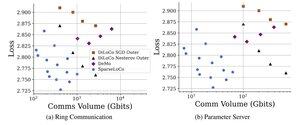

Apresentando o SparseLoCo: um método eficiente de comunicação para pré-treinamento de LLM.

TL; DR: Aproveitamos a esparsificação Top-k + feedback de erro com as etapas externas pouco frequentes do DiLoCo - comunicando apenas gradientes de 1 a 3% com quantização de 2 bits - superando DiLoCo e DeMo. 1/N,

ArXiv:

Github:

38,11K

Melhores

Classificação

Favoritos