المواضيع الرائجة

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

CodecFlow

طبقة التنفيذ لمشغلي الذكاء الاصطناعي والروبوتات على @Solana

CA: 69LjZUUzxj3Cb3Fxeo1X4QpYEQTboApkhXTysPpbpump

لا تزال VLAs جديدة جدا ويجد الكثير من الناس صعوبة في فهم الفرق بين VLAs و LLMs.

فيما يلي نظرة عميقة على كيفية اختلاف أنظمة الذكاء الاصطناعي هذه في التفكير والاستشعار والعمل. الجزء 1.

دعنا نقسم الفروق الرئيسية وكيف تختلف عوامل الذكاء الاصطناعي الملفوفة حول LLM عن وكلاء المشغل الذين يستخدمون نماذج VLA:

1. الإحساس: كيف ينظرون إلى العالم

الوكيل (LLM): يعالج النصوص أو البيانات المنظمة، مثل JSON وواجهات برمجة التطبيقات وأحيانا الصور. إنه مثل الدماغ الذي يعمل بمدخلات نظيفة ومجردة. فكر في قراءة دليل أو تحليل جدول بيانات. رائع للبيئات المنظمة ولكنه مقيد بما يتم تغذيته به.

المشغل (VLA): يشاهد وحدات البكسل الأولية في الوقت الفعلي من الكاميرات، بالإضافة إلى بيانات المستشعر (مثل اللمس والموضع) واستقبال الحس العميق (الوعي الذاتي بالحركة). إنه مثل التنقل في العالم بالعيون والحواس ، والازدهار في الإعدادات الديناميكية والفوضوية مثل واجهات المستخدم أو المساحات المادية.

2. التصرف: كيف يتفاعلون

الوكيل: يعمل عن طريق استدعاء الوظائف أو الأدوات أو واجهات برمجة التطبيقات. تخيل ذلك كمدير يرسل تعليمات دقيقة مثل "حجز رحلة عبر Expedia API". إنه متعمد ولكنه يعتمد على أدوات مسبقة الصنع وواجهات واضحة.

المشغل: ينفذ إجراءات مستمرة منخفضة المستوى، مثل تحريك مؤشر الماوس أو الكتابة أو التحكم في مفاصل الروبوت. إنه مثل العامل الماهر الذي يتلاعب بالبيئة بشكل مباشر ، وهو مثالي للمهام التي تتطلب دقة في الوقت الفعلي.

3. السيطرة: كيف يتخذون القرارات

الوكيل: يتبع حلقة بطيئة وعاكسة: التخطيط ، استدعاء أداة ، تقييم النتيجة ، التكرار. إنه مرتبط بالرمز المميز (مقيد بمعالجة النص) ومرتبط بالشبكة (في انتظار استجابات واجهة برمجة التطبيقات). هذا يجعلها منهجية ولكنها بطيئة للمهام في الوقت الفعلي.

المشغل: يعمل ، ويتخذ قرارات تدريجية في حلقة تغذية مرتدة ضيقة. فكر في الأمر كلاعب يتفاعل على الفور مع ما يظهر على الشاشة. تتيح هذه السرعة تفاعلا سلسا ولكنها تتطلب معالجة قوية في الوقت الفعلي.

4. البيانات للتعلم: ما الذي يغذي تدريبهم

الوكيل: مدرب على مجموعات نصية واسعة أو تعليمات أو وثائق أو مجموعات بيانات RAG (Retrieval-Augmented Generation). يتعلم من الكتب أو التعليمات البرمجية أو الأسئلة الشائعة ، ويتفوق في التفكير على المعرفة المنظمة.

المشغل: يتعلم من العروض التوضيحية (على سبيل المثال، مقاطع فيديو لبشر يؤدون المهام) أو سجلات التشغيل عن بعد أو إشارات المكافأة. إنه مثل التعلم من خلال المشاهدة والممارسة ، وهو مثالي للمهام التي تكون فيها التعليمات الصريحة نادرة.

5. أوضاع الفشل: حيث تنكسر

الوكيل: عرضة للهلوسة (اختلاق الإجابات) أو خطط الأفق الطويل الهشة التي تنهار إذا فشلت خطوة واحدة. إنه مثل الخبير الاستراتيجي الذي يبالغ في التفكير أو يسيء قراءة الموقف.

المشغل: يواجه تحولا متغيرا (عندما لا تتطابق بيانات التدريب مع ظروف العالم الحقيقي) أو أخطاء مركبة في التحكم (أخطاء صغيرة كرة ثلج). إنه مثل سائق يفقد السيطرة على طريق غير مألوف.

6. Infra: التكنولوجيا التي تقف وراءهم

الوكيل: يعتمد على موجه/موجه لتحديد الأدوات التي يجب استدعاؤها، وسجل أداة للوظائف المتاحة، والذاكرة/RAG للسياق. إنه إعداد معياري ، مثل مركز القيادة الذي ينسق المهام.

المشغل: يحتاج إلى خطوط أنابيب استيعاب الفيديو ، وخادم إجراءات للتحكم في الوقت الفعلي ، ودرع أمان لمنع الإجراءات الضارة ، ومخزن مؤقت لإعادة التشغيل لتخزين التجارب. إنه نظام عالي الأداء مصمم للبيئات الديناميكية.

7. حيث يضيء كل منهما: بقعهم الحلوة

الوكيل: يهيمن على مهام سير العمل باستخدام واجهات برمجة التطبيقات النظيفة (على سبيل المثال، أتمتة العمليات التجارية)، أو التفكير في المستندات (على سبيل المثال، تلخيص التقارير)، أو إنشاء التعليمات البرمجية. إنه خيارك المفضل للمهام المنظمة عالية المستوى.

المشغل: يتفوق في البيئات الفوضوية الخالية من واجهة برمجة التطبيقات مثل التنقل في واجهات المستخدم عالية الكعب أو التحكم في الروبوتات أو التعامل مع المهام الشبيهة باللعبة. إذا كان ينطوي على تفاعل في الوقت الفعلي مع أنظمة غير متوقعة ، فإن VLA هي الملك.

8. النموذج العقلي: مخطط + فاعل

فكر في وكيل LLM على أنه المخطط: فهو يقسم المهام المعقدة إلى أهداف واضحة ومنطقية.

مشغل VLA هو الفاعل ، وينفذ هذه الأهداف من خلال التفاعل المباشر مع وحدات البكسل أو الأنظمة المادية. يراقب المدقق (نظام أو وكيل آخر) النتائج لضمان النجاح.

$CODEC

32.92K

يقدم Codecflow Optr نهجا موحدا لبناء الوكلاء الذين يرون ويسببون ويتصرفون في البيئات الرقمية والمادية. سواء كان ذلك أتمتة سير عمل سطح المكتب ، أو التحكم في أذرع الروبوت ، أو الاختبار في المحاكاة ، فإنه يستخدم نفس النموذج العقلي والبدائيات.

Louround 🥂21 أغسطس 2025

Dips in a bull market are meant to be bought, especially on projects with big catalysts

We all know that AI is the narrative of this cycle, started by ai16z and Virtuals last year.

My bet is that the market will focus on more complex and sophisticated technologies such as VLAs, and let me tell you why.

LLMs (Large Language Models) mainly read and write text: they’re great at explaining, planning, and generating instructions, but they don’t by themselves control motors or interact with the physical world (as you may have experienced with chatgpt).

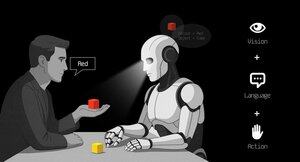

VLAs (Vision Language Action models) differ from LLMs as they are multimodal systems that look at things (vision), understand instructions (language), and directly produce actions. It's like telling a robot to pick up a red cup and then moving its arm to do it.

VLAs are trained on examples that pair images/video + instructions + real action traces (how a robot actually moved), and they must run fast and safely in real time. LLMs on their side are trained on huge text collections and focus on reasoning and language tasks.

TL;DR LLMs think and speak whil VLAs see, reason, and act.

As you can see, VLAs are a major addition to LLMs and will notably enable the next 0 to 1 innovation in the overall economy that will be robotics. A majority of investment funds are allocating a large part of their investments into this sector, seen as the next logical evolution in the AI industry.

I already made a post a while ago on the current leader in the crypto market, @codecopenflow, which did not raise capital (fair launch) yet is shipping cutting-edge products and currently sitting at $23M FDV.

For information, other crypto competitors raised $20m ( @openmind_agi) at what is probably a $200M to $300M ++ FDV while no product or community has been built and shipped yet.

What makes Codec a leading project in the sector is that they tackle a crucial bottleneck in robotics and AI, which is the difficulty to have all the AI tools interact together. Let me explain.

Their latest release, OPTR (operator), is a toolkit that helps build operators capable of interacting on multiple platforms such as robots, desktops, browsers, or simulations. The objective of an operator is to see, reason, and act (VLA) in both digital (computers) and physical (robots) worlds.

This toolkit serves as core infrastructure for robotic teams aiming to test their product and enhance the overall process by providing a unified experience instead of separate ones for web browsers, simulations, or robots. This essentially makes the operator adaptive and autonomous regardless of its environment.

So you get it, it will save big time for companies and developers who previously had to go through each step manually and where you can save time you can save money.

It will also enable Codec to build their own operator projects and launch new capacities relatively fast onto the market, notably through their marketplace.

TL;DR: You probably have seen videos of robots folding tissues, sorting boxes, or jumping on various elements. They have all been trained for this very specific use case, and unfortunately, one skill cannot be re-used in another environment like a human could do. OPTR from Codec solves this by making skills transferrable among environments and situations, making training and development a lot faster and cheaper for enterprises.

This is why Codec is so interesting in unifying the digital world with the physical world.

$CODEC, Coded.

3.67K

الأفضل

المُتصدِّرة

التطبيقات المفضلة